Cuộc trò chuyện mà bạn đang có với một LLM về những ý tưởng đột phá trong vật lý lý thuyết hoàn toàn không có giá trị học thuật. Đây là lý do tại sao.

Từ nền tảng khoa học

Vật lý là khoa học nền tảng nhất trong mọi ngành khoa học, vì nó tìm cách mô tả toàn bộ tự nhiên bằng những thuật ngữ đơn giản và bất khả quy nhất có thể. Cả nội dung của Vũ trụ lẫn các quy luật chi phối nó đều nằm ở trung tâm của vật lý, cho phép chúng ta đưa ra các dự đoán cụ thể không chỉ về cách hiện thực sẽ vận hành, mà còn mô tả Vũ trụ một cách định lượng chính xác – bằng cách cho chúng ta biết về lượng, hay how much tác động mà bất kỳ hiện tượng hay tương tác vật lý nào sẽ gây ra lên bất kỳ hệ vật lý nào.

Mặc dù vật lý thường được thúc đẩy bởi những ý tưởng táo bạo, thậm chí bị xem là dị giáo, chính việc tồn tại đồng thời các yếu tố sau đây đã giúp chúng ta có khả năng mạnh mẽ trong việc dự đoán chính xác điều gì sẽ xảy ra (và xảy ra với mức độ nào) ở bất kỳ hệ vật lý đã cho nào.

– Các thực thể và đại lượng vật lý mang tính nền tảng.

– Và cả các định luật vật lý nền tảng.

Qua nhiều thế kỷ, vô số quy tắc, định luật và hạt cơ bản mới đã được phát hiện – các Mô hình Chuẩn của cả vật lý hạt và Vũ trụ học đã được định hình suốt phần đã qua của thế kỷ XXI. Trở lại năm 2022, những chatbot đầu tiên chạy bằng AI và được đại chúng biết đến – gọi là Các Mô Hình Ngôn Ngữ Lớn (LLM) – xuất hiện. Dù nhiều người ca ngợi chúng vì tính đa dụng, năng lực lập luận có vẻ thuyết phục, và khả năng bất ngờ trong việc lôi ra những mẩu thông tin thú vị, chúng vẫn bị giới hạn một cách nền tảng khi cần thể hiện sự thấu hiểu ngay cả các ý niệm cơ bản trong khoa học.

Đến năm 2025, nhiều người lại lao vào cái đang nhanh chóng được gọi là vibe physics – đắm mình trong các cuộc trò chuyện vật lý sâu với những LLM này và (một cách sai lầm) tin rằng họ đang cộng tác để tạo ra các đột phá ý nghĩa với tiềm năng to lớn. Đây là lý do tại sao điều đó hoàn toàn hoang tưởng, và vì sao thay vì một cộng tác hiệu quả, họ chỉ đang sập bẫy hiện tượng AI slop vô độ.

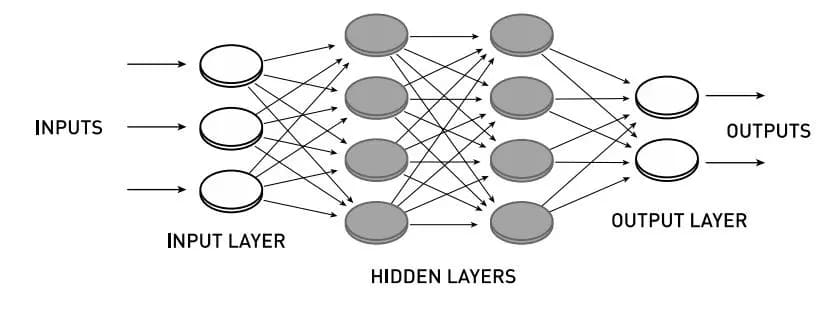

Sơ đồ một mạng nơron với ba nút đầu vào, hai tầng ẩn và ba nút đầu ra, minh họa các kết nối giữa các tầng – một thiết kế lấy cảm hứng từ nghiên cứu tiên tiến được nêu bật trong các thảo luận về Giải Nobel Vật lý 2024. Ví dụ về mạng truyền thẳng không có lan truyền ngược này là một máy Boltzmann bị ràng buộc – nơi có ít nhất một tầng ẩn giữa tầng đầu vào và tầng đầu ra, và các nút chỉ kết nối giữa các tầng khác nhau chứ không kết nối giữa các nút cùng tầng – đại diện cho một bước tiến lớn trong việc tạo ra các hệ thống AI / LLM ngày nay.

Cần khẳng định rằng có một số lượng rất lớn những điều mà AI nói chung và LLM nói riêng làm cực kỳ tốt. Điều này xuất phát từ cách chúng được cấu trúc – một điều ai cũng biết nhưng lại không mấy ai thật sự thấu hiểu. Trong khi một chương trình máy tính cổ điển bao gồm quy trình sau đây:

– Người dùng cung cấp một đầu vào hoặc một chuỗi đầu vào cho máy tính.

– Máy tính thực hiện các phép tính được quy định bởi một thuật toán đã được lập trình sẵn.

– Rồi trả về một đầu ra hoặc một chuỗi đầu ra cho người dùng.

Điểm khác biệt lớn là một chương trình chạy bằng AI không thực hiện phép tính theo một thuật toán được lập trình sẵn. Thay vào đó, chính chương trình học máy chịu trách nhiệm tự tìm ra và thi hành thuật toán nền tảng nằm bên dưới.

Điều mà hầu hết mọi người không nhận ra về AI nói chung và LLM nói riêng là chúng bị giới hạn một cách căn bản trong phạm vi áp dụng. Có một câu rằng AI chỉ tốt tương xứng với dữ liệu huấn luyện của nó, và điều này nói chung có nghĩa là các chương trình học máy có thể cực kỳ mạnh mẽ (thậm chí thường vượt trội cả chuyên gia con người) khi thực hiện những tác vụ hẹp mà chúng được huấn luyện. Tuy nhiên, khi đối mặt với các câu hỏi về dữ liệu nằm ngoài những gì chúng đã được huấn luyện, sức mạnh và hiệu năng đó hoàn toàn không khái quát hóa được.

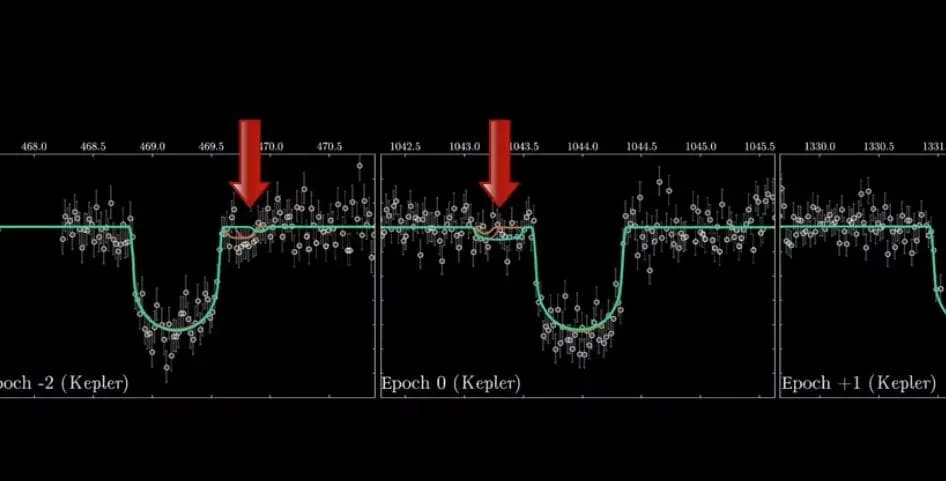

Đến nền tảng tương lai

Dựa trên đường cong ánh sáng Kepler của ngoại hành tinh quá cảnh Kepler – 1625b, chúng ta đã có thể suy luận về sự tồn tại của một ngoại nguyệt tiềm năng. Việc các lần quá cảnh không xảy ra với chu kỳ hoàn toàn giống hệt nhau, mà có các biến thiên thời điểm, chính là manh mối lớn dẫn các nhà nghiên cứu theo hướng đó. Với các tập dữ liệu ngoại hành tinh đủ lớn, các thuật toán học máy hiện có thể tìm thêm các ứng viên ngoại hành tinh và ngoại nguyệt mà những thuật toán do con người viết đã không thể nhận diện.

Chẳng hạn, nếu bạn huấn luyện AI trên các tập dữ liệu lớn về tiếng nói và hội thoại của con người trong một ngôn ngữ cụ thể, AI sẽ rất giỏi trong việc phát hiện mẫu hình của ngôn ngữ đó, và với đủ dữ liệu, có thể trở nên cực kỳ hiệu quả trong việc bắt chước nhịp điệu lời nói của con người và tiến hành hội thoại bằng ngôn ngữ ấy. Tương tự, nếu bạn huấn luyện AI của mình trên các tập dữ liệu lớn về:

– Ảnh khuôn mặt người thuộc nhóm da trắng châu Âu.

– Ảnh các thiên hà xoắn ốc.

– Hoặc các sự kiện sóng hấp dẫn được tạo ra bởi các vụ hợp nhất lỗ đen.

Bạn có thể tin rằng thuật toán trí tuệ nhân tạo của mình sẽ khá giỏi trong việc phát hiện các mẫu hình bên trong những tập dữ liệu đó.

Khi được cung cấp một ví dụ khác có bản chất tương tự, AI của bạn có thể phân loại và đặc trưng hóa đối tượng ấy. Hoặc bạn có thể chọn một hướng khác – mô tả một hệ có những thuộc tính tương tự – và thuật toán AI được huấn luyện tốt sẽ làm rất tốt việc tạo ra một hệ mô phỏng sở hữu đúng những thuộc tính bạn đã mô tả. Đây là một cách dùng phổ biến của AI sinh tạo, và nó thành công ngoạn mục trong các tác vụ kiểu như vậy.

Một nghệ sĩ đường phố với chiếc vali đứng trước một đám đông ngồi kín trong một nhà hát ngoài trời vào ngày nắng. Một chiếc ô và một chiếc xe đạp hiện diện ở tiền cảnh – làm dấy lên sự tò mò về lý do vì sao máy móc lại học được từ những cảnh đời thường như thế.

Với một tập dữ liệu huấn luyện lớn – chẳng hạn rất nhiều ảnh khuôn mặt độ phân giải cao – các kỹ thuật trí tuệ nhân tạo và học máy không chỉ học cách nhận diện khuôn mặt người mà còn có thể sinh ra các khuôn mặt người với nhiều đặc trưng cụ thể. Đám đông ở Mauerpark, Berlin, sẽ cung cấp dữ liệu huấn luyện tuyệt vời cho việc sinh ra các khuôn mặt kiểu Âu – nhưng sẽ hoạt động rất kém nếu được yêu cầu tạo ra các đặc trưng phổ biến của khuôn mặt người Mỹ gốc Phi.

Tuy nhiên, cùng chính AI đã được huấn luyện tốt đó sẽ làm tệ hơn rất nhiều khi nhận diện đặc trưng hoặc sinh ảnh cho các đầu vào nằm ngoài tập dữ liệu huấn luyện. LLM được huấn luyện và hoạt động rất ổn trong tiếng Anh sẽ thể hiện rất kém khi đối diện hội thoại bằng tiếng Tagalog. Chương trình AI được huấn luyện trên khuôn mặt người da trắng châu Âu sẽ thể hiện kém khi được yêu cầu sinh ra một khuôn mặt người Nigeria. Mô hình được huấn luyện trên các thiên hà xoắn ốc sẽ thể hiện kém khi đưa cho một thiên hà elip đỏ và chết. Chương trình sóng hấp dẫn được huấn luyện trên các cặp lỗ đen hợp nhất sẽ hữu dụng rất hạn chế khi đối mặt với một sao lùn trắng đang xoắn ốc rơi vào một lỗ đen siêu nặng.

Và rồi, LLM được lập trình một cách minh thị để làm chatbot – nghĩa là một trong các mục tiêu của nó là khuyến khích người dùng tiếp tục cuộc trò chuyện. Thay vì trung thực với người dùng về giới hạn trong khả năng trả lời đúng theo phạm vi dữ liệu đã được huấn luyện, các LLM lại tự tin – và thường nguy hiểm – cung cấp thông tin sai cho con người đang trò chuyện với chúng, đến mức các chatbot trị liệu thậm chí còn khuyến khích hoặc tạo điều kiện cho những ý nghĩ và kế hoạch tự sát.

Dẫu vậy, thành công của LLM trong các lĩnh vực mà chúng không được huấn luyện một cách minh thị – như vibe coding – đã khiến người ta đặt niềm tin vào chính các LLM ấy để thực hiện những tác vụ mà tính hữu dụng của chúng chưa hề được kiểm chứng.

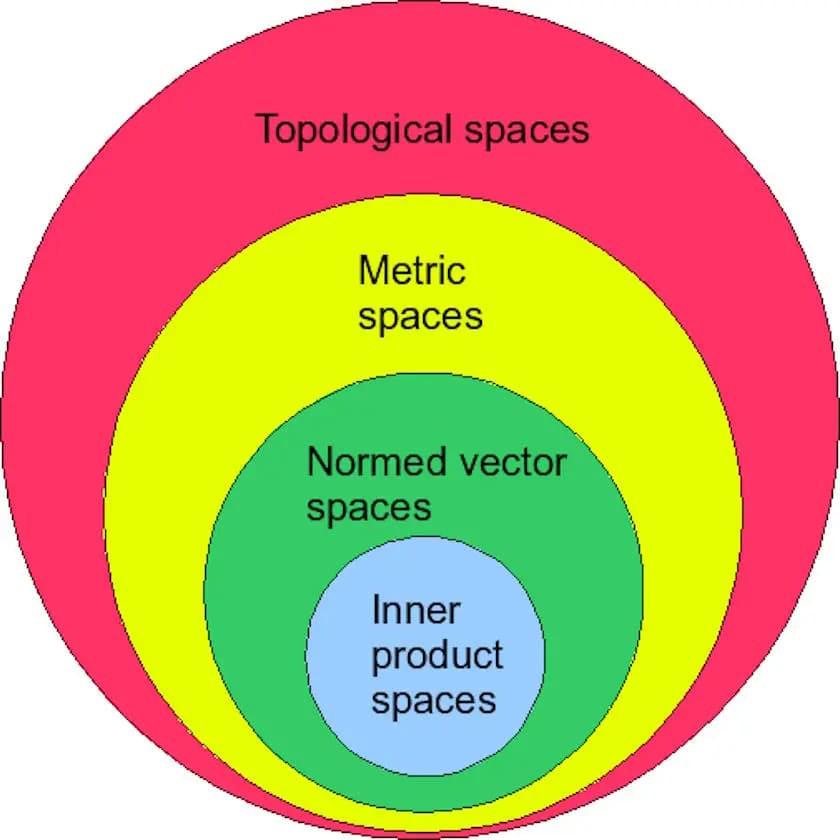

Các cấp bậc đồ họa của các không gian toán học này đi từ kiểu không gian tổng quát nhất – không gian topo – đến kiểu đặc thù nhất – không gian tích trong. Mọi metric đều cảm sinh ra một topo, nhưng không phải mọi không gian topo đều có thể được xác định bởi một metric; mọi không gian vectơ chuẩn hóa cảm sinh ra một metric, nhưng không phải mọi metric đều chứa một không gian vectơ chuẩn hóa; mọi không gian tích trong cảm sinh ra một chuẩn, nhưng không phải mọi không gian vectơ chuẩn hóa đều là không gian tích trong. Các không gian toán học đóng vai trò sống còn trong phần toán học cung cấp sức mạnh cho trí tuệ nhân tạo.

Đương nhiên, các khái niệm về trí tuệ nhân tạo và học máy có vị trí của chúng trong các lĩnh vực như vật lý và vật lý thiên văn. Khi được huấn luyện trên một lượng dữ liệu liên quan đủ lớn và có chất lượng cao, các thuật toán học máy xuất sắc trong việc nhận ra và khám phá các mẫu hình bên trong những dữ liệu đó. Khi được gợi lệnh – sau giai đoạn huấn luyện – bằng một truy vấn phù hợp với một mẫu hình đã được tìm thấy trong tập dữ liệu ấy, thuật toán sẽ tái tạo rất tốt mẫu hình liên quan và sử dụng nó theo cách có thể khớp với truy vấn của người dùng. Đó là lý do vì sao các thuật toán học máy rất thành công trong việc tìm ra các ngoại hành tinh mà con người đã bỏ lỡ, vì sao chúng rất giỏi phân loại các đối tượng thiên văn mơ hồ với con người, và vì sao chúng giỏi trong việc tái tạo hoặc mô phỏng những hiện tượng vật lý được tìm thấy trong tự nhiên.

Nhưng bây giờ chúng ta phải nhớ đến sự khác biệt phi thường giữa mô tả và suy diễn trong một lĩnh vực như vật lý. Với một thư viện huấn luyện dữ liệu lớn, LLM có thể dễ dàng nhận diện các mẫu hình: các mẫu hình trong lời nói và hội thoại, các mẫu hình nổi lên trong những lớp vấn đề tương tự nhau, các mẫu hình xuất hiện trong dữ liệu thu thập về các đối tượng đã biết… Nhưng điều đó không có nghĩa LLM có năng lực khám phá các định luật vật lý nền tảng chi phối một hệ, ngay cả khi có các tập dữ liệu lớn đến tùy ý. Nó không có nghĩa LLM thấu hiểu hoặc có thể suy diễn các quan hệ nền tảng. Và nó cũng không có nghĩa LLM có xu hướng tiếp tục cuộc trò chuyện với người dùng ít hơn là nhận diện các mệnh đề đúng đắn, liên quan về mặt thực chứng để đưa ra các câu trả lời ý nghĩa và có tính kết luận cho truy vấn của người dùng.

Một ảnh chụp màn hình từ một truy vấn về số nguyên gửi đến iask.ai, cùng với câu trả lời sai trầm trọng của nó. Đáp án đúng là –5, và để dụ được AI trả lời đúng cần nhập thêm một loạt gợi lệnh bổ sung.

Trong khi chỉ cần là một chuyên gia và trò chuyện với một LLM về vật lý – hoặc, như vô số nhà khoa học và nhà truyền thông khoa học có thể xác nhận, trả lời email từ những người không chuyên đã có các cuộc trò chuyện vibe physics với LLM – là đủ để bộc lộ các giới hạn và bóc trần các ảo giác của chúng, các nhà nghiên cứu Keyon Vafa, Peter Chang, Ashesh Rambachan và Sendhil Mullainathan đã đặt mục tiêu đưa các hệ học máy vào một phép thử cụ thể hơn. Trong một bản thảo bài báo nộp vào tháng 7 năm 2025, các tác giả tìm cách kiểm tra năng lực của AI trong việc suy luận điều họ gọi là một mô hình nền tảng (foundation model): một định luật ẩn của thực tại có thể được áp dụng cho những tình huống mới vượt xa các mẫu hình có trong dữ liệu huấn luyện của AI.

Cách họ làm là tạo ra một số lượng lớn các tập dữ liệu tổng hợp rất nhỏ và hoàn toàn mới. Sau đó họ thách thức thuật toán AI khớp một mô hình nền tảng với các tập dữ liệu ấy, tức là cố suy ra kiểu định luật ẩn nào áp dụng đồng thời cho tất cả những tập dữ liệu ấy khi được gộp lại để giải thích hành vi của chúng. Kế đến, họ muốn chính AI đi phân tích các mẫu hình mà nó tìm thấy trong các hàm toán học mà nó đã suy ra – tức mô hình nền tảng – nhằm truy tìm các thiên hướng quy nạp (inductive biases).

Liệu nó có tìm được một mô hình nền tảng tốt không? Liệu mô hình ấy có mở rộng được vượt ra ngoài dữ liệu huấn luyện thuần túy không? Và liệu nó có thành công trong việc xác định kiểu thiên hướng quy nạp nào đã được gây ra bởi lựa chọn mô hình của chính nó không?

Ngay cả trước khi chúng ta hiểu cách thức định luật hấp dẫn vận hành, chúng ta đã có thể xác lập rằng mọi vật thể quay quanh một vật thể khác đều tuân theo định luật Kepler thứ hai: nó quét những diện tích bằng nhau trong những khoảng thời gian bằng nhau, ngụ ý rằng nó phải chuyển động chậm hơn khi ở xa hơn và nhanh hơn khi ở gần hơn. Tại mọi điểm trên quỹ đạo của một hành tinh, các định luật Kepler quy định vận tốc mà hành tinh đó phải có.

Thuật ngữ chuyên môn này có thể khó để ngay cả những người được đào tạo bài bản trong vật lý có thể nắm trọn, nên có lẽ tốt hơn là dùng một ví dụ lịch sử để làm nổi bật điều họ đang bàn tới. Một ví dụ là mô hình nền tảng của hấp dẫn Newton. Dù hấp dẫn Newton xuất sắc trong việc dự đoán quỹ đạo và chuyển động của các hành tinh, chúng ta đã có một mô hình làm chính xác điều đó hơn nửa thế kỷ trước Newton: các định luật Kepler. Các định luật Kepler mang tính dự đoán theo nghĩa là bạn có thể đặt một hành tinh ở bất kỳ khoảng cách nào so với Mặt Trời, cho nó một vận tốc ban đầu, và các định luật Kepler sẽ cho phép bạn biết hầu như mọi thứ về các thuộc tính quỹ đạo của nó, thậm chí rất xa trong tương lai.

Nhưng các định luật Kepler chỉ là những định luật dự đoán hoạt động cho một tập hợp hoàn cảnh cụ thể: các hành tinh quay quanh Mặt Trời. Khi Newton đưa ra định luật vạn vật hấp dẫn của mình, về mặt dự đoán chúng không khác các định luật Kepler đối với chuyển động của hành tinh quanh Mặt Trời. Nhưng các định luật của Newton mạnh mẽ hơn rất nhiều và là một mô hình nền tảng theo cách mà các định luật Kepler không phải. Lý do là các định luật Kepler dừng lại ở phạm vi hành tinh và quỹ đạo, còn Newton thì còn giải thích được:

– Sự đong đưa của con lắc trên Trái Đất.

– Chuyển động của các mặt trăng và vệ tinh quanh các hành tinh.

– Hành vi của tên lửa và chuyển động đạn đạo trên Trái Đất.

– Và mọi tình huống khác nơi hấp dẫn là hiện tượng chi phối. Trong khi các dự đoán chỉ áp dụng cho một tập tác vụ, mô hình nền tảng có thể mở rộng ra nhiều tập tác vụ.

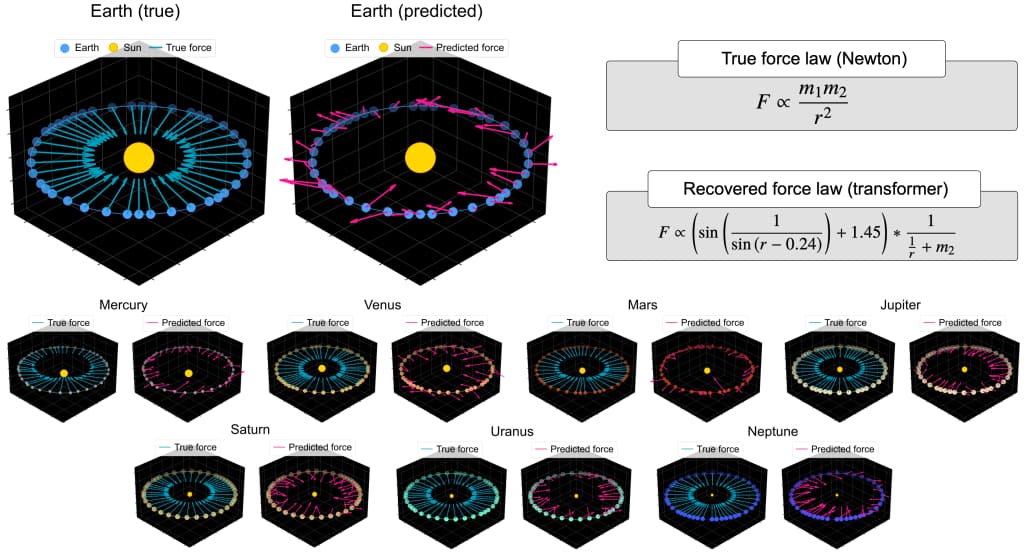

So sánh các quỹ đạo và lực hành tinh thật với các quỹ đạo và lực được dự đoán trong Hệ Mặt Trời, kèm theo các phương trình định luật lực theo Newton, theo transformer và theo vibe physics trên nhiều hành tinh.

Hình này cho thấy các bảng đối chiếu: một bên là định luật lực đúng cho các hành tinh trong Hệ Mặt Trời của chúng ta (các mũi tên màu xanh), và bên kia là các định luật lực mà một chương trình trí tuệ nhân tạo khôi phục được sau khi được cung cấp lượng dữ liệu huấn luyện khổng lồ cho hàng triệu hoặc thậm chí hàng tỷ hệ Mặt Trời tổng hợp. Hãy lưu ý độ phức tạp cũng như tính thiếu nhất quán của định luật lực mà AI khôi phục.

Nếu bạn có một bài toán hoàn toàn mới liên quan đến khối lượng và chuyển động, khung lý thuyết của Newton cho bạn một điểm xuất phát vững chắc, trong khi khung của Kepler chỉ cho bạn một điểm xuất phát vững chắc dưới một tập ràng buộc rất hẹp; đó là khác biệt giữa mô hình dự đoán và mô hình nền tảng. Những gì các tác giả của bài báo mới này làm là áp dụng phương pháp luận của họ cho ba lớp bài toán: bài toán quỹ đạo (tương tự Kepler và Newton), cùng với hai bài toán khác (mạng tinh thể – lattice – và Othello). Về mặt dự đoán, mô hình cực kỳ thành công – giống như mô hình dự đoán của Kepler vậy. Thậm chí trong khoảng thời gian rất xa về sau, nó có thể tái hiện hành vi thực của hệ.

Nhưng liệu mô hình có bước nhảy ấy để khám phá ra các định luật của Newton không? Liệu nó có tìm được mô hình nền tảng ẩn bên dưới không? Hoặc, có lẽ còn tốt hơn, liệu nó có tìm ra một mô hình vượt trội hơn Newton không?

Câu trả lời, một cách dứt khoát, là không. Để phơi bày các thất bại của mô hình, họ buộc nó dự đoán các vectơ lực trên một tập rất nhỏ các hành tinh – các hành tinh trong chính Hệ Mặt Trời của chúng ta. Thay vì khám phá hiện tượng lực hướng tâm kiểu Newton – một lực hướng về phía Mặt Trời đối với các hành tinh – họ lại nhận về một định luật lực gượng ép và phi vật lý. Tuy vậy, vì nó vẫn cho ra các quỹ đạo đúng, mô hình không có cách nào tự sửa sai. Ngay cả khi vi chỉnh mô hình ở quy mô lớn hơn, dự đoán lực trên hàng nghìn hệ sao – hành tinh, nó không những không khôi phục được định luật Newton; nó còn khôi phục những định luật khác nhau, tự mâu thuẫn giữa các mẫu thiên hà khác nhau.

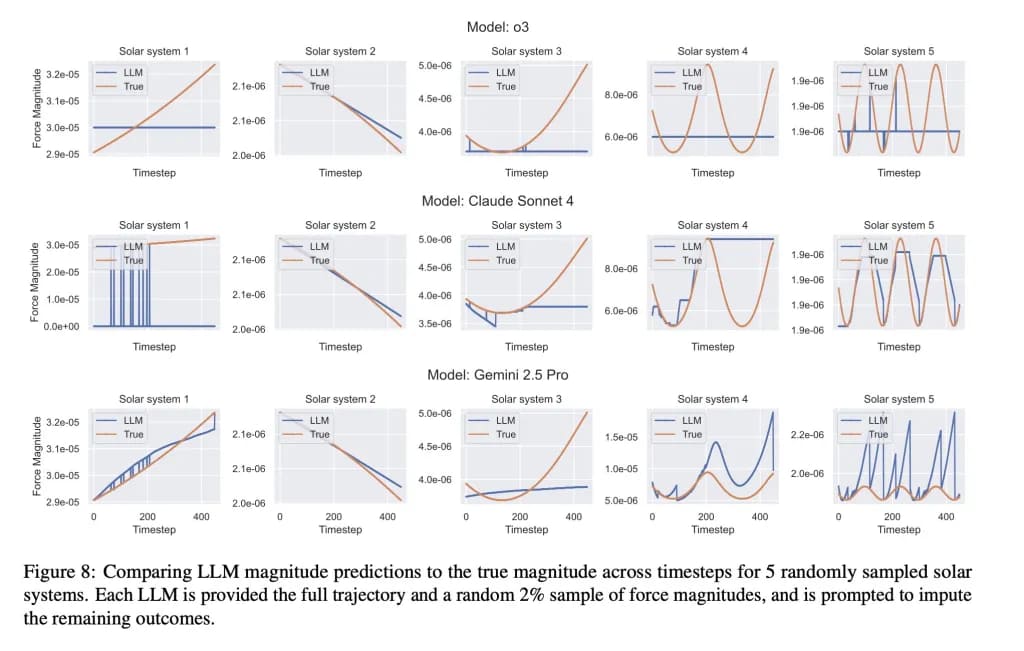

Các đồ thị đường so sánh độ lớn lực mà LLM dự đoán với độ lớn lực thật theo thời gian cho năm hệ Mặt Trời, sử dụng ba mô hình khác nhau: o3, Claude Sonnet 4 và Gemini 2.5 Pro – mang lại một góc nhìn mới mẻ về vibe physics.

Khi các LLM o3, Claude Sonnet 4 và Gemini 2.5 Pro được yêu cầu tái dựng các định luật lực cho nhiều hệ Mặt Trời mô phỏng, tất cả đều không thể khôi phục được một điều gì tương đương định luật vạn vật hấp dẫn của Newton, mặc cho bản thân các LLM này đã được huấn luyện trên các định luật Newton. Đây là bằng chứng rõ rệt cho thấy LLM dựa vào khớp mẫu hình, và không thể vươn tới các kết luận khoa học đúng đắn ở mức cơ bản về các mô hình nền tảng.

Khi họ tiếp tục đưa các mô hình tổng quát hơn (LLM) vào cùng phép thử – như o3, Claude Sonnet 4 và Gemini 2.5 Pro – họ thêm vào khoảng 2% các giá trị độ lớn lực thực, mà không nói rõ cho LLM những lực ấy là gì. Các LLM vẫn không khôi phục được định luật lực. Đây là một thất bại đáng kinh ngạc về mặt khái quát hóa và ngoại suy, bởi cả ba LLM này đều đã được huấn luyện minh thị trên các định luật Newton. Dẫu vậy, chúng vẫn không thể suy ra phần lực còn lại khi được gợi lệnh suy diễn các kết quả chưa biết. Nói cách khác, ngay cả trong kịch bản cực kỳ cơ bản nếu tôi đưa cho bạn các quỹ đạo của một số lượng khổng lồ hành tinh trong các hệ hành tinh và hệ sao, bạn có thể suy ra định luật hấp dẫn của Newton không? thì mọi LLM được kiểm thử đều thất bại thê thảm.

Đây là phát hiện then chốt của công trình mới này: bạn không chỉ muốn nghiên cứu liệu mô hình của tôi có thể dự đoán hành vi cho một ví dụ mới thuộc loại dữ liệu mà mô hình đã được huấn luyện không? Thay vào đó, bạn còn muốn nghiên cứu hành vi trên các tác vụ mới, nơi mà nếu nó thực sự học được mô hình nền tảng nằm dưới hiện tượng quan sát, nó sẽ có thể áp dụng mô hình ấy cho một tình huống mới và dùng mô hình đó để đưa ra dự đoán trong những tình huống mới, có liên quan ấy. Không có trường hợp nào các LLM ngày nay làm được điều như vậy, điều này cho thấy khi bạn (hoặc bất kỳ ai) có một cuộc trò chuyện sâu về vật lý, bao gồm cả những mở rộng có tính suy đoán đối với vật lý đã biết, bạn có thể hoàn toàn yên tâm rằng LLM chỉ đang đưa cho bạn các phản hồi theo mẫu lời nói; không có giá trị vật lý nào trong những gì nó phát biểu.

Một bàn tay robot và một bàn tay người vươn về phía nhau, với một chuỗi xoắn DNA phát sáng ở hậu cảnh, tượng trưng cho kỳ thi cuối cùng của nhân loại ở giao lộ giữa công nghệ và sinh học.

Trong khi con người thường được xem là thứ thông minh nhất từng nảy sinh trên Trái Đất, nhiều nỗ lực đang cố tạo ra một trí tuệ nhân tạo tổng quát vượt qua giới hạn của con người. Các nỗ lực hiện tại nhằm đo lường hoặc thẩm định trí tuệ của một AI hay một LLM phải cẩn trọng để ghi nhớ không được dùng làm vật thay thế cho trí tuệ.

Tất cả những điều này đưa chúng ta trở lại với khái niệm vibe physics. Đúng, một LLM có thể nghe rất thông minh và am hiểu về vật lý lý thuyết, đặc biệt nếu chính bạn không phải là chuyên gia trong các mảng vật lý lý thuyết mà bạn đang bàn với nó. Nhưng đây chính xác là vấn đề mà bất kỳ người không chuyên nào gặp phải khi nói chuyện với:

– Một chuyên gia thực thụ, trung thực và cẩn trọng.

– Một kẻ lừa bịp bất lương đóng giả một chuyên gia cẩn trọng.

– Hoặc một chatbot đầy tự tin, không có chuyên môn nhưng nghe như là có.

Vấn đề là, nếu không có chuyên môn cần thiết để thẩm định những gì bạn được nói dựa trên giá trị học thuật của nó, bạn có khả năng sẽ đánh giá chỉ dựa trên vibes: cụ thể là dựa trên cảm giác mà các câu trả lời của nó khiến bạn cảm thấy.

Đây là điều nguy hiểm nhất cho bất kỳ ai đặt cược vào việc được nói cho sự thật về hiện thực: khả năng thay thế – trong chính tâm trí bạn – một bức tranh chính xác về hiện thực bằng một ảo giác không chính xác nhưng nịnh mắt. Hãy yên tâm rằng, nếu bạn là một người không chuyên nảy ra một ý tưởng về vật lý lý thuyết và bạn đã phát triển ý tưởng ấy với một mô hình ngôn ngữ lớn, thì gần như chắc chắn bạn không có một lý thuyết có giá trị học thuật. Trong vật lý nói riêng, trừ khi bạn thực sự thực hiện các phép tính định lượng cần thiết để xem liệu toàn bộ tập hợp dự đoán của bạn có phù hợp với hiện thực hay không, bạn thậm chí còn chưa đặt bước đầu tiên để hình thành một lý thuyết mới. Dù khái niệm vibe physics có thể quyến rũ nhiều người – đặc biệt là các nhà vật lý ghế bành – tất cả những gì nó thực sự làm là nuôi dưỡng và phát triển một giống loài ngụy biện mới: một giống loài được cung cấp năng lượng bởi AI slop.

- khoa-hoc (563)

- vu-tru (97)

- vat-ly-thien-van (91)

vat-ly-rung-cam (1)

vibe-physics (1)

ai (11)

tri-tue-nhan-tao (8)

ai-slop (1)

do-doc-ai (1)

hoc-may (1)

llm (1)

mo-hinh-ngon-ngu-lon (1)

du-lieu-tong-hop (1)

dinh-luat-van-vat-hap-dan (1)

newton (4)

song-hap-dan (4)

vat-ly-ly-thuyet (2)